חמישים גוונים של דאטה ואתגרים ל- AI ארגוני

המרוץ ליישומי AI בארגונים והיתרון התחרותי שמצפים מהם , גורם לכל ארגון לבחון אין ספור מקרי שימוש , כדי להוביל את החברה לתוצאות ממשיות ואסטרטגיה ברורה, הן עבור העובדים ותהליכים הפנימיים והן עבור השירותים המסופקים ללקוחות החיצונים .

בשנות 2023 עד 2025 חברות Hyperscale's, סטרטאפים , וקהילות מפתחי קוד פתוח השקיעו ושמו דגש על בנייה ואימון של מודלי AI חזקים וחכמים , המתמחים באלף ואחד תחומי עבודה מגוונים כגון טיפול ב Languages, Medias, Vision, Sciences , Robotics , ועוד הרבה תחומים אחרים .

כיום שפע של מודלים מאומנים ומתוחכמים זמינים לנו לשימוש חופשי או בתשלום, וניתנים בקלות לאינטגרציה באפליקציות הארגוניות שלנו, או מסופקים לנו כמודלים מובנים בתוך יישומי מדף שהארגון ירכוש לטיפול בתהליכים עסקיים .

שנת 2026 מקפיצה אותנו חזק מאוד בעולם החדש של ה- Inferencing ( שימוש במודל מאומן על הדטה הארגוני או דטה חדש משתנה ברצף) בשילוב עם סוכני AI שיחברו וישפיעו ,מהמודל "על", את עולם הפיזי או אפליקטיבי שלנו בתוך הארגון . כולנו שמענו רבות על מגמה זו , לכן לא נתעכב עליה היום , כמו שלא נתעכב על בחירה בסוג כזה או אחר של כרטיסי GPU לטובת סוג כזה או אחר של יישום או מקרה שימוש AI.

אבל מה שפחות שומעים, ושאינו פחות חשוב מתשתית ה- GPU עצמה , הוא שעולם ה-Inferencing מאוד תובעני בגישה לדאטה שלנו.

הדטה הקיים מופיע בארגון בהרבה גוונים שונים שאותם צריך לדעת לקרוא ואפילו לשנות או לפרמט, ולשלב במהירות "על" ובפרוטוקולים שונים ( File , Object , Block and DB's Access, or Stream Access ). כאתגר נוסף , יישומים אלו מייצרים וכותבים דטה חדש במסות שלא דמיינו עד כה.

לדוגמה: יישום LLM מתוחכם מסוג "GPT ארגוני" שבתהליך ה- Embedding ו-Vectorization של הדטה הקיים בארגון , יכול לייצר בין פי 10 לפי 30 יותר נפח מי הדטה המקור.

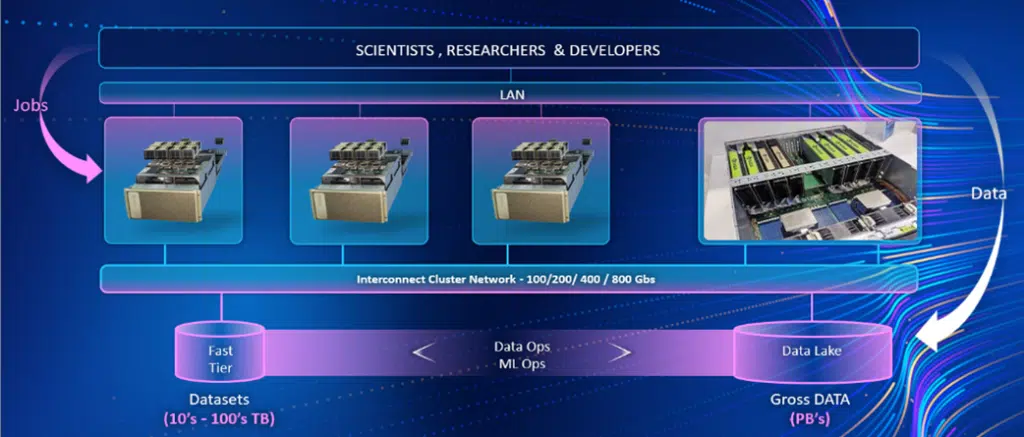

עד כה האתגר , כיצד אנו ניגשים לפתרון בחטיבת המחשוב בבינת במסגרת הכלים ההנדסיים המוכרים לנו

האם מערכות האחסון המסורתיות שעבדנו איתן או הכרנו עד כה ב- IT , אינן מותאמות לעולם הזה ? איך מספקים את כל הפרוטוקולים ביחד, ב- SCALE של Petabytes ולא רק מאות Terabytes , במהירות קריאה וכתיבה מאוד גבוהים, כדי למקסם את עבודת כרטיסי ה- GPU שזמינים לנו בתשתית הארגונית , וכל זה בעלות סבירה וברת הישג ?

והתשובה הינה : כן. יש צורך בזן חדש של מערכות אחסון.

אחד הפתרונות הבולטים היום בשוק ה- AI , הן אצל חברות ה- NEO CLOUD , והן בארגונים שמיישמים AI בתוך החברה, מגיע לנו שוב מהחדשנות הכחול לבן , ומתפשט כבשורה טכנולוגית מרעננת ויעילה עבור כל היישומיים התובעניים אלו. (Training, Inferencing,Data Lakes , HPC, Mass Backup and Recover, … )

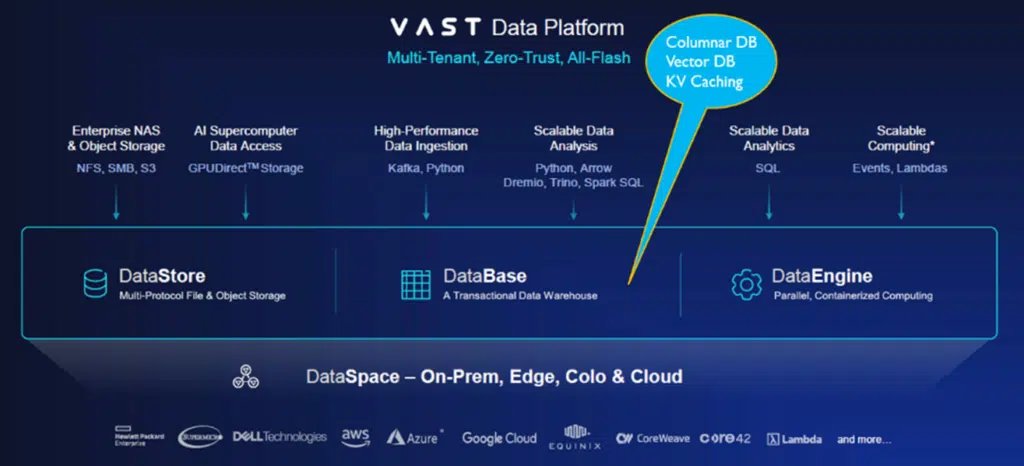

מערכת אחסון מחברת VAST מספקת פתרון הוליסטי לכל use Case שניתן לפגוש בעולם ה-AI , HPC ו-IT בפלטפורמה אחת:

- Fully Containerized and scalable Modern software Architecture

- Multi-Protocol files and Object Storage access (NFS, SMB, S3)

- Built-In Scalable SQL, Columnar and Vector DB's

- Key Value Caching for large LLM implementation

- Built-in Data Engines and Analytics services for Data Flows and Ingestion

- Very High Read & Write (from 10's to 100's GB/s) Performance

- Global Inline Deduplication and compression for cost saving

חברת בינת , ביצעה בשנים אחרונות , בקרב לקוחותיה, אין ספור פרויקטים של תשתיות AI 360, וצברה ניסיון עשיר בתחום. כשותף בכיר של חברת NVIDIA ושל יצרני שרתי GPU מובילים בעולם, ולאחר שזיהינו את החשיבות של הפתרון, הקמנו לפני מעל שנה , שיתוף פעולה אסטרטגי עם חברת VAST הישראלית לטובת הפרויקטים ולקוחותינו